En ny generation af computer-chips sætter turbo på anvendelsen af kunstig intelligens.

Den britiske matematiker, Alan Turing, var i 1940’erne med til at udvikle verdens første programmerbare computer. Senere udtænkte Turing et banebrydende computerprogram til at spille skak. Men den computer, som Turing havde adgang til, var for langsom til at afvikle programmet, og han kunne derfor kun afprøve det ved selv at udføre alle de programmerede beregninger.

Halvtreds år senere præsenterede IBM “Deep Blue”, en supercomputer, der ikke alene kunne spille skak, men som også to gange i træk vandt over den regerende verdensmester.

I dag kan skakprogrammer på en almindelig notebook rutinemæssigt vinde over de bedste skakspillere i verden.

Historien viser, at inden for computervidenskab halter den teknologiske udvikling efter menneskers evne til at udtænke nye anvendelsesmuligheder.

Det gælder også inden for kunstig intelligens.

De grundlæggende ideer til udvikling af “intelligente” programmer har været på tegnebrættet i årtier, men det er først med udviklingen af Skyen og de store globale datacentre, at programmører har fået adgang til de enorme kræfter, der skal til for at realisere ideerne.

Skyen har derfor sat fart i udviklingen af kunstig intelligens, eller Artificial Intelligence, AI.

AI-betegnelsen dækker over et bredt felt af forskellige teknologier, men interessen samler sig især om at videreudvikle den klassiske “maskinlæring”, der i årtier har været anvendt inden for afgrænsede områder.

Eksplosionen i adgangen til computerkraft har åbnet mulighed for at videreudvikle denne teknologi til det, der i dag betegnes som “Deep Learning”.

Den traditionelle “flade” maskinlæring, der fungerer i ét lag, udvides med denne metode til at fungere i flere “dybe” lag, hvor hvert nyt lag kan lære af de underliggende lag.

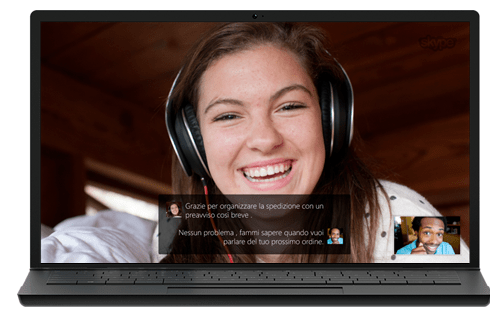

Deep Learning har gjort det muligt at udvikle banebrydende løsninger som selvkørende biler, automatiseret screening af røntgenbilleder og oversættelser af samtaler i realtid for blot at nævne nogle få eksempler.

Teknologien rummer mange muligheder men, der er også udfordringer.

En af udfordringerne er, at man ikke altid ved, hvad der foregår inde i programmet.

For eksempel er det muligt at udvikle en Deep Learning-løsning til at udføre screening af røntgenbilleder, og løsningen kan på kort tid opnå en kvalitet, der matcher eller overgår de bedste lægers evne til at fortolke røntgenbillederne.

Men det er et mysterium, hvordan Deep Learning-løsningen rent faktisk udfører fortolkningen af billederne.

Man kan konstatere, at løsningen fungerer, men man ved ikke – og man kan i princippet ikke finde ud af – hvordan den virker.

Denne uigennemsigtighed rejser mange politiske og etiske spørgsmål, for hvad kan man overlade til maskiner, der bygger på en teknologi, som vi ikke forstår?

En mere grundlæggende udfordring er, at Deep Learning er en ekstremt ressourcekrævende teknologi.

Energiforbruget til at gennemføre de nødvendige computerberegninger er enormt.

Det hænger sammen med, at de nødvendige computerkræfter tilvejebringes ved, at man sætter et stort antal traditionelle computere sammen i forbundne systemer.

Traditionelle computere er ikke beregnet til at håndtere de store mængder af beregninger, der indgår i Deep Learning-systemer, og det er kun ved at strække teknologien til det yderste, at det overhovedet er muligt at få løsningerne til at fungere.

Begrænsningerne i de eksisterende computersystemer hænger sammen med den arbejdsdeling mellem program, data og beregning, der finder sted inde i en computer.

Arbejdsdelingen foregår ved, at et program læses ind i hukommelsen, eller RAM, hvorefter programmet henter data ind i RAM, for eksempel fra en harddisk. Efterfølgende sender programmet udvalgte data til behandling i computerens processor.

Når data er behandlet i processoren sendes resultatet tilbage til RAM, hvor programmet bruger beregningerne til et nærmere bestemt formål, der ofte indebærer, at data sendes retur til processoren til nye beregninger.

Hele denne trafik med at flytte rundt på data fungerer fint med et regneark og også med langt mere krævende programmer. Men med Deep Learning løber antallet af transaktioner mellem program, data og processor op i himlen, for eksempel når computeren skal kunne “se”, om der går en fodgænger ud foran en selvkørende bil.

Den klassiske arkitektur for computing er simpelthen ikke bygget til at håndtere de komplekse beregninger, der indgår i udviklingen af Deep Learning.

Den fortsatte udvikling af AI har derfor igangsat et kapløb mellem en gruppe startups, der forsøger at udvikle en ny generation af computerchips, der er optimeret til at understøtte AI-løsninger.

I dette kapløb fører den engelske virksomhed Graphcore, der siden etableringen i 2016 har rejst 300 millioner $ til udviklingsarbejdet, svarende til omkring to milliarder kroner.

Graphcore har netop lanceret sin første chip, der med over 1200 processorer mast sammen på et område på størrelse med et frimærke, er den hidtil mest komplekse computerchip i verden.

Arkitekturen i chippen er specielt udviklet til at begrænse trafikken mellem data, program og processor. Designet gør det muligt at placere data og programmer direkte på chippen og på den måde kan Deep Learning-programmer afvikles op til 100 gange hurtigere end på chips med den traditionelle arkitektur.

Denne hastighedsforøgelse betyder både, at udviklingen af nye Deep Learning programmer kan gennemføres langt hurtigere, og at færdigudviklede programmer fungerer mere effektivt og med et lavere energiforbrug.

Graphcores udviklingsarbejde er et godt eksempel på den globale dimension i udviklingen af kunstig intelligens, der uden sammenligning er den mest komplekse teknologi mennesker hidtil har udviklet.

Graphcore er grundlagt af to englændere, der begge er veteraner inden for chipindustrien.

Hovedkontoret ligger i den engelske by, Bristol, men nye afdelinger er på vej i Norge, Taiwan og USA.

Den forholdsvis lille stab af medarbejdere stammer fra alle hjørner af verden.

Kapitalen kommer fra USA, med Google og Microsoft blandt investorerne, og fra Tyskland, hvor BMW og Robert Bosch Venture Capital begge er investorer. Desuden omfatter investorkredsen flere globale kapitalfonde som Amadeus Capital Partners, C4 Ventures, Dell Technologies Capital, Draper Esprit, Foundation Capital, Pitango, Samsung og Sequoia Capital.

Produktionen af chippen foregår hos TSMC i Taiwan, der er en de få eller måske reelt den eneste virksomhed i verden, der råder over den nødvendige knowhow og det fysiske produktionsapparat til at producere chippen.

Graphcore hyldes som et eksempel på at Europa er i stand til at frembringe en tech-virksomhed, der har potentialet til at blive en global spiller i top 10.

Men den nationale eller regionale forankring er i stigende grad en illusion.

Graphcore er måske først og fremmest et eksempel på, at tech er blevet en global industri i en global økonomi.

Henvisninger og baggrund: 27-01-2019